新一代大数据与人工智能基础架构与软件开发 融合、演进与未来

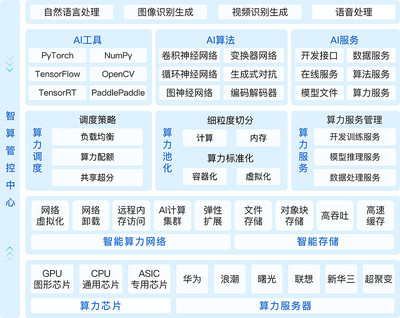

随着数据量的爆炸式增长和人工智能(AI)算法的不断突破,大数据与人工智能(AI)的融合已成为推动数字化转型的核心引擎。新一代基础架构技术与AI基础软件的发展,正从相互独立的支撑系统,演变为一个深度融合、协同进化的智能计算生态。其核心趋势在于构建能够高效处理海量数据、敏捷支撑复杂AI模型训练与推理、并实现资源智能调度的统一平台。

一、 基础架构的融合与演进:从分立到统一

传统的大数据平台(如Hadoop/Spark生态)与AI计算平台(如GPU集群)往往各自为政,导致数据移动成本高、资源利用率低、运维复杂。新一代基础架构的核心方向是“融合”。

- 存算分离与数据湖仓一体化:通过对象存储等低成本、高扩展的存储方案实现存算分离,使计算资源可根据负载弹性伸缩。数据湖(灵活存储原始数据)与数据仓库(高结构化管理)的边界正在模糊,形成湖仓一体(Lakehouse)架构,如Databricks Delta Lake、Snowflake等。这为AI提供了单一、一致、高质量的数据源,避免了复杂的数据管道与复制。

- 异构计算与硬件加速:AI训练与推理催生了对多样化算力的需求。基础架构正广泛集成CPU、GPU、NPU、FPGA乃至专用AI芯片(如TPU)。通过Kubernetes等容器编排技术,实现对异构算力的统一调度与管理,让合适的任务跑在合适的硬件上,最大化性价比。

- 云原生与无服务器化:云原生技术(容器、微服务、服务网格)已成为构建敏捷、弹性AI基础设施的事实标准。无服务器计算(Serverless)进一步将资源管理抽象化,让开发者专注于代码和模型,基础架构按需自动扩缩容,显著降低了运维负担和启动成本,特别适合波动性的AI推理任务。

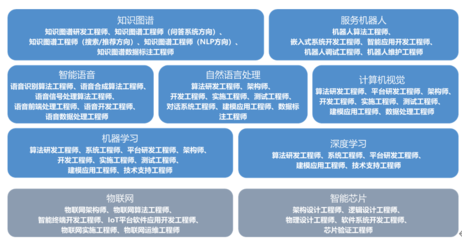

二、 人工智能基础软件的崛起:标准化、自动化与平民化

AI基础软件是连接底层硬件、数据与上层AI应用的“操作系统”和“工具链”,其发展旨在降低AI开发与应用的门槛。

- 统一的开源框架与生态:PyTorch和TensorFlow两大框架持续演进,在易用性、性能和大规模分布式训练方面不断竞争与融合。面向高阶抽象的框架如JAX(专注于高性能数值计算)、MindSpore(端边云全场景)等也在拓宽生态。ONNX等开放模型格式促进了框架间的互操作性。

- MLOps的工程化实践:AI模型从实验到生产部署的鸿沟,正通过MLOps(机器学习运维)来弥合。MLOps工具链涵盖了数据版本管理(如DVC)、实验跟踪(如MLflow)、模型注册、持续训练/部署(CI/CD)、监控与治理等全生命周期。这使AI模型的迭代、部署和运维像软件工程一样可重复、可靠和高效。

- 自动化机器学习与低代码平台:AutoML技术通过自动化特征工程、模型选择、超参数调优等步骤,让非专家也能构建有竞争力的模型。企业级AI平台和低代码/无代码AI开发工具(如云服务商提供的可视化工具)正推动AI应用的“平民化”,使业务专家能直接参与AI解决方案的构建。

- 大模型与基础模型基础设施:以GPT、DALL-E等为代表的大模型(Large Language Models, LLMs)兴起,对基础软件提出了新要求。催生了专门用于大模型训练(如DeepSpeed、Megatron-LM的分布式优化)、微调(LoRA等高效技术)、部署(如vLLM等高性能推理引擎)和服务的工具链。开源与闭源的“模型即服务”(MaaS)平台也正在形成。

三、 未来趋势与挑战

- 软硬件协同设计与绿色计算:针对特定AI负载(如Transformer)的定制化芯片与编译优化软件将更紧密协同,追求极致性能与能效比。“绿色AI”要求基础架构和软件在追求精度时,必须权衡计算成本与碳排放。

- 隐私保护与可信AI:联邦学习、差分隐私、可信执行环境(TEE)等技术将更深度地集成到基础架构和软件中,实现“数据不动模型动”或安全计算,满足日益严格的数据合规要求。模型的可解释性、公平性工具也将成为基础软件的标准组件。

- 边缘-云协同智能:基础架构将跨越数据中心、边缘和终端,形成分级协同的连续体。相应的AI基础软件需支持模型的轻量化、自适应部署与跨环境协同推理。

- AI for System与System for AI的良性循环:AI不仅是被支撑的应用,其本身也将用于优化基础架构,如利用AI进行数据中心冷却管理、网络流量调度、硬件故障预测等,形成自我优化的智能基础设施。

新一代大数据与AI基础架构及软件的发展,本质是构建一个数据与智能无缝流动、算力高效普惠、开发运维高度自动化的数字基石。这个基石正从支撑“AI实验”转向支撑“AI工业化生产”,从而加速千行百业的智能化进程。成功的关键在于拥抱开源、云原生、融合架构,并持续投资于能够管理复杂性与不确定性的软件工程能力和平台工具。

如若转载,请注明出处:http://www.hzhylae.com/product/85.html

更新时间:2026-06-07 15:11:44